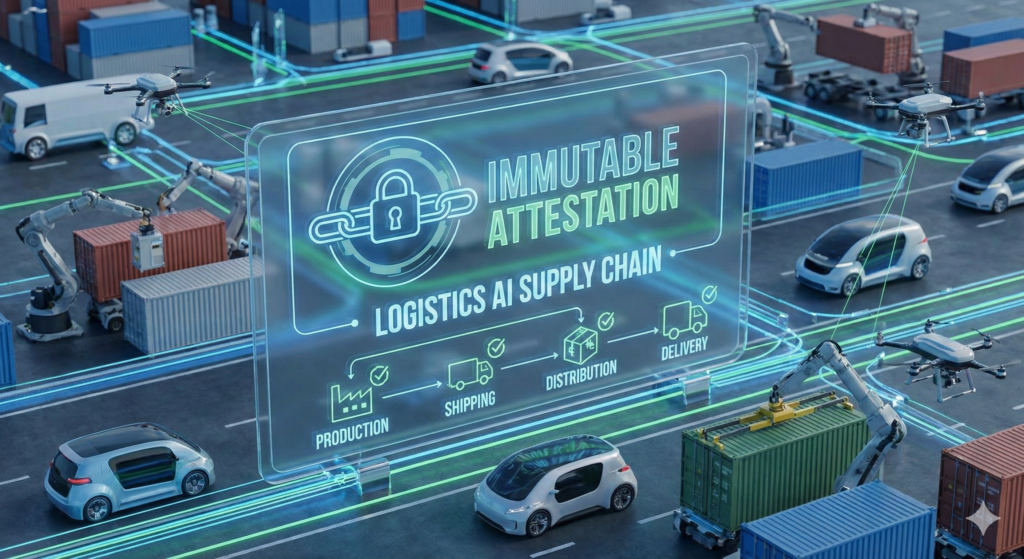

Atestación Inmutable para IA Logística

Atestación Inmutable: Mitigación de Riesgos Algorítmicos y Cumplimiento Regulatorio Bajo la EU AI Act (2024-2027)

1.- El Imperativo de la Integridad de Datos en la IA Logística (Contexto Estratégico)

La Inteligencia Artificial (IA) ha pasado de ser una ventaja tecnológica a un componente operacional indispensable dentro de la Logística 4.0. La transformación digital del sector depende intrínsecamente de la calidad y confiabilidad de los modelos predictivos y generativos, que sustentan decisiones críticas en la cadena de suministro. Sin embargo, la escalabilidad y la confianza en estos sistemas se ven constantemente desafiadas por riesgos crecientes en la integridad de los datos, lo que exige la adopción de nuevas arquitecturas de gobernanza basadas en tecnologías de registro distribuido (DLT).

1.1.- La IA como Pilar de la Logística 4.0 y la Convergencia Estratégica

La adopción de la IA en la logística representa un imperativo estratégico fundamental para la resiliencia y la competitividad. Las empresas que integran la IA generativa (GenAI) reportan resultados convincentes, incluyendo una mejora sustancial en la productividad, la capacidad de respuesta al cliente y la toma de decisiones basada en datos.[1] Normalmente, las firmas de logística que adoptan estas herramientas experimentan un retorno de la inversión (ROI) completo dentro de 18 a 24 meses. La IA permite la automatización de tareas repetitivas, como la creación de etiquetas de envío multilingües, que antes eran manuales y propensas a errores.[2] Más allá de la automatización, las capacidades predictivas son cruciales para detectar problemas potenciales de manera proactiva, utilizando datos históricos y de terceros (condiciones meteorológicas, cierres de puertos, huelgas) para ajustar expectativas y redirigir productos.[2]

El éxito de la IA corporativa depende tanto de la visión como de la adopción a escala.[3] El valor transformador de la IA se obtiene no solo de grandes saltos, sino también del resultado acumulativo de ganancias incrementales de productividad del 20% al 30% a lo largo de diferentes áreas operativas.[3] Esta integración profunda y sistémica exige una base de confianza robusta. Cuando la tecnología se convierte en un driver de efectividad al permitir la predicción de riesgos y el seguimiento ambiental, social y de gobernanza (ESG), la necesidad de confiar en la fuente y la transformación de los datos se vuelve tan crítica como la propia capacidad predictiva.[4]

1.2.- La Crisis de Confianza Algorítmica y la Necesidad de Verificabilidad

A pesar de los beneficios, la dependencia de la IA introduce una serie de riesgos críticos. Uno de los más significativos, destacado por firmas de consultoría, es la inexactitud.[5] Esta puede originarse en una gestión deficiente de los datos, fallos propios al modelo o resultados que carecen de explicación adecuada (lack of explicability), lo que puede generar graves consecuencias operacionales, financieras y un deterioro de la confianza del cliente.[5]

Los Modelos de IA están expuestos a riesgos operacionales como la desviación del modelo (model drift), el sesgo y las fallas en la estructura de gobernanza. Si estos riesgos no se abordan, pueden explotarse vulnerabilidades de ciberseguridad.[6] La robustez y la seguridad son requisitos esenciales: un sistema de IA robusto debe gestionar condiciones excepcionales y anomalías de entrada sin causar daños involuntarios, y debe estar diseñado para resistir interferencias intencionales mediante la protección contra vulnerabilidades expuestas.[6] Garantizar que los modelos se basen en datos precisos e inalterados es fundamental para reducir la incidencia de errores procedentes de fuentes defectuosas y mejorar la confiabilidad del sistema.[5]

1.3.- Definición de la Atestación Blockchain como Capa de Gobernanza DLT

Ante la necesidad de gestionar riesgos y demostrar robustez, la Atestación Blockchain emerge como la capa de gobernanza tecnológica necesaria para asegurar la integridad de datos. Se define operativamente como el proceso de anclar criptográficamente el linaje de los datos (procedencia) y los registros de eventos del modelo (event-logging) a un Distributed Ledger Technology (DLT) para garantizar la inmutabilidad y la verificabilidad por terceros.

Históricamente, la gestión de la trazabilidad de datos (data provenance) se basaba en bases de datos centralizadas, lo que presentaba el riesgo de manipulación de datos o la falta de confiabilidad debido a la deshonestidad o el fallo de un centro de confianza único. de documentación a un control de seguridad activo y verificable. Este enfoque es esencial para la adopción masiva de la IA, ya que permite escalar sin aumentar proporcionalmente el riesgo algorítmico y legal.

2.- Marco Regulatorio (2024-2027): EU AI Act y el Mandato de Provenance

El marco regulatorio de la Unión Europea, liderado por la EU AI Act (Acto de IA), establece un precedente global para el desarrollo seguro, ético y responsable de la IA. Este marco impone obligaciones estrictas sobre la gobernanza y la integridad de los datos, haciendo que la trazabilidad inmutable se convierta en un requisito de cumplimiento no negociable para los sistemas de IA utilizados en logística.

2.1.- Clasificación de Sistemas de IA Logística como Alto Riesgo

La AI Act, en vigor desde agosto de 2024 con una implementación gradual hasta agosto de 2027, clasifica los sistemas de IA en diferentes niveles de riesgo. [10, 11] Los sistemas de alto riesgo están sujetos a los requisitos más rigurosos.[11] En el sector logístico, los sistemas que afectan la seguridad y la salud, como los utilizados como componentes de seguridad de productos regulados o la gestión de infraestructuras críticas, caen dentro de la definición de “alto riesgo”.

Las obligaciones para los sistemas de alto riesgo incluyen la implementación de sistemas de gestión de riesgos y calidad, la realización de evaluaciones de conformidad obligatorias y la notificación de incidentes graves.[12] Las normas relativas a estos sistemas tienen un período de transición extendido, siendo plenamente aplicables hasta el 2 de agosto de 2026, y hasta el 2 de agosto de 2027 para aquellos sistemas incrustados en productos regulados.[10]

2.2.- Obligaciones de Data Governance y el Mandato de Integridad del Dato

Para los sistemas de alto riesgo, la ley establece un deber de cuidado explícito en la gestión de datos. Los proveedores están obligados a llevar a cabo la gobernanza de datos, asegurando que los conjuntos de datos utilizados para entrenamiento, validación y prueba sean relevantes, suficientemente representativos y, “en la mayor medida posible, libres de errores y completos” de acuerdo con el propósito previsto del sistema.[13]

Este requisito se extiende a lo largo de la cadena de valor de la IA. Los implementadores (usuarios finales, como operadores logísticos) que ejercen control sobre los datos de entrada también deben asegurar que dicha información cumpla con los estándares de integridad.[14] La trazabilidad de los datos (Data Provenance), que es la capacidad de rastrear el origen, la historia y las transformaciones de los datos a lo largo de su ciclo de vida, se convierte en la herramienta fundamental para establecer la confianza, la transparencia y el cumplimiento dentro de los ecosistemas digitales.[15]

Cuando una organización demuestra que sus datos están “libres de errores” [13], está, de hecho, probando su diligencia debida en el proceso de curación y validación de datos. En un entorno legal, los registros centralizados son insuficientes para probar esta diligencia. La atestación inmutable se convierte en la única herramienta creíble para documentar y probar el cumplimiento del deber de cuidado, mitigando la responsabilidad futura.

2.3.- Mantenimiento de Registros y Trazabilidad en la Cadena de Valor

La AI Act exige que los sistemas de alto riesgo se diseñen para el mantenimiento automático de registros (record-keeping), registrando eventos relevantes para la identificación de riesgos y modificaciones sustanciales a lo largo de todo el ciclo de vida del sistema.[13] Los proveedores deben elaborar documentación técnica para demostrar la conformidad y deben proporcionar instrucciones de uso a los implementadores downstream (usuarios posteriores) para que estos también puedan cumplir con la gobernanza de datos.[13]

Además de los sistemas de alto riesgo tradicionales, las reglas de gobernanza también se aplican a los modelos de IA de Propósito General (GPAI), que se volvieron aplicables en agosto de 2025.[10] Si una empresa de logística utiliza modelos fundamentales (GPAI) para tareas operativas críticas, debe garantizar que la adaptación del modelo (fine-tuning) y los datos de entrada cumplan con las obligaciones de AI Act. La atestación inmutable es crucial para certificar la capacidad de adaptación y los datos utilizados sobre el GPAI.

La trazabilidad generada por la atestación se alinea no solo con la AI Act, sino también con otras regulaciones emergentes, como la Ley de Resiliencia Cibernética (CRA), que obliga a los fabricantes de hardware y software a implementar la “seguridad por diseño” a lo largo de todo el ciclo de vida del producto.[16]

El siguiente cuadro detalla cómo los requisitos de AI Act son directamente asistidos por las soluciones de atestación DLT.

Tabla 2.1: Matriz de cumplimiento de la Ley de IA de la UE: sistemas de alto riesgo y requisitos de procedencia

| Requisito de la Ley de IA (alto riesgo) | Foco del Riesgo en Logística | Atestación Blockchain (VCs/EAS) como Facilitador | Fuente |

| Datos de Entrenamiento: Integridad y Representatividad | Mitigar el sesgo y los errores que llevan a decisiones subóptimas (eg, rutas ineficientes, sesgo de inventario). | Credencial Verificable (VC) firmada por el Ingeniero de ML y anclada en DLT, certificando el cumplimiento del Data Governance Plan (incluyendo métricas de sesgo). | [13, 14] |

| Mantenimiento de Registros y Registro de Eventos de Ciclo de Vida | Capacidad para realizar auditorías forenses tras fallos, desviaciones del modelo (deriva) o ataques internos. | Uso de Ethereum Attestation Service (EAS) o un sistema similar para registrar de forma inmutable cada cambio de configuración, actualización de pesos del modelo, y evento de entrenamiento/ reentrenamiento. | [12, 13] |

| Evaluación de la Conformidad | Demostrar objetivamente a las autoridades competentes (AI Office) que el sistema cumple con los estándares de rendimiento y seguridad. | Utilización de Zero Knowledge Proofs (ZKPs) para generar pruebas de rendimiento (Proof of Performance) sin revelar la arquitectura del modelo, satisfaciendo el requisito regulatorio y protegiendo la Propiedad Intelectual. | [12, 17] |

3.- Riesgos de Integridad Algorítmica en el Contexto Industrial

La acelerada adopción de la IA en entornos operativos críticos de la logística ha expuesto a la cadena de suministro a un nuevo espectro de ciberataques y fallos sistémicos centrados en la manipulación de los datos o los modelos. La Atestación DLT es una contramedida directa a tres vectores de riesgo primarios: el envenenamiento de datos, la vulnerabilidad de la cadena de suministro de ML y la degradación recursiva del modelo.

3.1.- Data Poisoning y Manipulación de Modelos: Ataques Persistentes

El Data Poisoning es una amenaza crítica que ocurre antes del tiempo de ejecución (runtime). Implica la incrustación de instrucciones maliciosas o engañosas en el conjunto de datos que el modelo utiliza para aprender o recuperar información.[18] Esto provoca un cambio de comportamiento persistente en el modelo, a menudo insertando una “puerta trasera” que el atacante puede activar posteriormente.[18] En la logística, la manipulación de datos de demanda, niveles de inventario o datos de desempeño de transporte a través de envenenamiento puede comprometer directamente la eficiencia operativa, la rentabilidad y la planificación. Más allá de los datos de entrenamiento, los atacantes pueden comprometer directamente la integridad de un modelo al alterar sus componentes centrales, como su arquitectura, pesos o parámetros.

Estos cambios manipulados comprometen el comportamiento, la precisión y el rendimiento del sistema.[6] Dado que los controles de acceso o el cifrado tradicional son insuficientes para mitigar el envenenamiento de datos [19], es esencial que la seguridad se traslade al origen ya la transformación del dato. La atestación blockchain certifica criptográficamente la calidad y la inalterabilidad de los datos en el punto de origen o validación, neutralizando el impacto de la manipulación posterior.

3.2.- La Vulnerabilidad de la Cadena de Suministro de Machine Learning

Los ataques a la cadena de suministro de Machine Learning (ML) se están sofisticando, apuntando a los entornos de desarrollo y despliegue de los modelos. Ejemplos incluyen la explotación de bibliotecas Python vulnerables para comprometer aplicaciones LLM, como ocurrió en el primer caso de brecha de datos de OpenAI.[20] Ataques más complejos aprovechan las vulnerabilidades en marcos de IA como Ray, un sistema utilizado por muchos proveedores para gestionar la infraestructura de IA.[20]

Los riesgos también se extienden a la infraestructura en la nube.

Ataques como CloudBorne (explotación de vulnerabilidades de firmware en entornos compartidos) y CloudJacking (control malicioso de instancias en la nube) representan riesgos significativos, ya que un entorno comprometido puede exponer datos sensibles y facilitar el ataque a los modelos de ML.[20] El panorama de riesgo está agravado por un aumento documentado en la frecuencia de las brechas de seguridad que involucran a un tercero. El Informe de investigaciones de violación de datos de Verizon proyectado para 2025 indica que el 30% de las brechas involucrarán a un tercero, un aumento del 100%.[16]

Esta dependencia de terceros requiere que las organizaciones implementen mejores prácticas de “conoce a tu proveedor” (KYS).[19] La Atestación, mediante el uso de Identificadores Descentralizados (DIDs) y Credenciales Verificables (VCs), digitaliza y automatiza este control legal, creando un KYS Digital. Un proveedor de datos puede presentar un VC que certifique criptográficamente que su pipeline de datos está auditado y cumple con estándares de calidad, lo que proporciona una prueba verificable de la fuente y mitiga el riesgo de vulnerabilidades de la cadena de suministro de ML.

3.3.- Modelo Collapse y Degradación Recursiva

Un riesgo sistémico en el entrenamiento de la IA, especialmente con el uso creciente de modelos generativos (como GenAI en la logística), es el Model Collapse.[21, 22] Este fenómeno se confirma empíricamente: si los modelos se entrenan recursivamente sobre salidas sintéticas generadas por modelos anteriores, el rendimiento tiende a degradarse.[21]

La investigación académica de 2024 y 2025 confirma que eludir este riesgo requiere una estrategia de acumulación de datos, donde los datos sintéticos sucesivos se mezclan junto con los datos reales originales. Este proceso exige una trazabilidad estricta y clara para diferenciar la procedencia del dato real versus el sintético.[21] La Atestación Blockchain es la herramienta ideal para esta diferenciación. Mediante la certificación del origen (real o sintético) y el registro inmutable de la fuente, la atestación garantiza la calidad del input y previene el colapso del modelo, un riesgo que puede paralizar las capacidades predictivas en la logística.

4.- Arquitectura Técnica de la Atestación de Procedencia para ML

La implementación de la Atestación Blockchain para sistemas de Machine Learning (ML) requiere una arquitectura técnica avanzada que combine tecnologías DLT, identidades descentralizadas (SSI/VCs) y criptografía avanzada (ZKPs) para superar los retos de escalabilidad, privacidad y complejidad.

4.1.- DLT y Anchoring: Superando las Limitaciones de Escalabilidad

El uso de blockchain para la trazabilidad de datos (procedencia) es un campo de investigación activa.[7] El desafío clave en la gestión de la procedencia radica en el tamaño de los archivos, que a menudo exceden la capacidad de los bloques y contienen información sensible.[8]

La solución técnica se centra en el concepto de anclaje (anclaje): en lugar de incrustar el archivo de procedencia completo, se ancla un hash criptográfico (derivado de un árbol de Merkle) del contenido o del registro de eventos a una blockchain inmutable. Una estrategia avanzada para gestionar grandes volúmenes de datos es la división de un gráfico de procedencia en Múltiples subgrafos más pequeños, cifrando estos subgrafos e incrustando las versiones cifradas o sus hashes en una blockchain de consorcio (como una basada en Ethereum, eg, Hyperledger Besu). [8, 23] Este método permite un uso eficiente de la cadena, descentraliza la autorización de acceso y permite el rastreo eficiente del linaje de datos en diferentes dominios.[8]

4.2.- SSI y VCs: Construyendo un Marco de Procedencia Criptográfica

La Atestación se materializa a través de un marco de Identidad Auto-Soberana (SSI) y Credenciales Verificables (VCs). Este marco transforma un simple registro de eventos (log) en un activo criptográfico verificable con valor probatorio.

- Identificadores Descentralizados (DIDs): Se utilizan para establecer la identidad inmutable de todos los actores del ecosistema (desarrolladores, dispositivos IoT que capturan datos, modelos de IA). Plataformas como Hyperledger Indy actúan como un registro distribuido para administrar estos DID.[23]

- Credenciales Verificables (VCs): Son la columna vertebral de la atestación. Un VC es una afirmación firmada criptográficamente sobre un sujeto (un conjunto de datos, un modelo, un ingeniero) emitida por una entidad de confianza (un auditor, un sistema de calidad automatizado). Por ejemplo, un VC puede certificar que un conjunto de datos cumplió con métricas específicas de calidad y representación antes de ser inyectado en un modelo. La plataforma VeriTrust, por ejemplo, utiliza DIDs y VCs emitidos a través de Hyperledger Aries e Indy, y los ancla a una blockchain compatible con Ethereum, lo que proporciona una verificación de autenticidad basada en la procedencia.[23]

Los VC permiten la atestación formal en puntos de control críticos a lo largo del ciclo de vida de MLOps:

- Ingesta de Datos: Atestar la fuente y la validación inicial del dataset.

- Pre-procesamiento: Atestar que las transformaciones y anonimizaciones cumplen con los estándares éticos y legales (GDPR/AI Act).

- Entrenamiento: Atestar la versión de código, las dependencias, los pesos finales del modelo y los parámetros utilizados.

- Despliegue: Atestar el hash del modelo desplegado, asegurando que es la versión certificada que superó la evaluación de conformidad.[24]

Este enfoque modular y basado en estándares abiertos (W3C, ETSI NGSI-LD) garantiza la interoperabilidad y el futuro cumplimiento con las directrices regulatorias internacionales que aún están en desarrollo, como el plan de la NIST para el compromiso global en estándares de IA (NIST AI 100-5e2025).[15, 25]

4.3.- ZKML: Prueba de cumplimiento sin compromiso de IP

Las Pruebas de Conocimiento Cero (ZKPs) representan un avance crítico en la gestión de la tensión entre el cumplimiento normativo y la protección de la Propiedad Intelectual (PI). ZKML (Zero-Knowledge Machine Learning) permite a una parte probar que un modelo (o un proceso) se ha ejecutado de una manera específica, o que ha logrado ciertas métricas de rendimiento o imparcialidad (Proof of Performance), sin revelar los parámetros internos o la arquitectura sensible del modelo.

Para la IA de alto riesgo en logística, que debe demostrar la conformidad a las autoridades [12], ZKML ofrece una solución elegante. La estrategia “Predecir, luego probar” sugiere que el resultado de la inferencia se entrega al cliente o al sistema de logística inmediatamente, mientras que la prueba criptográfica de que la inferencia fue correcta y que cumplió con las métricas de conformidad se genera posteriormente y se registra en el DLT.[17] Esto protege al PI del proveedor de IA mientras cumple plenamente con la obligación de auditabilidad requerida por la AI Act.

5.- Mitigación del Riesgo Legal y Responsabilidad Algorítmica

El valor de la Atestación Inmutable se maximiza en el ámbito legal, proporcionando una defensa sólida contra la creciente amenaza de la Responsabilidad Algorítmica introducida por la Directiva de Responsabilidad por IA (AILD) de la UE.

5.1.- El Mecanismo de la Directiva de Responsabilidad por IA (AILD)

La AILD tiene como objetivo modernizar las normas de responsabilidad civil no contractual, garantizando que las víctimas de daños causados por sistemas de IA gocen del mismo nivel de protección que aquellas dañadas por otras tecnologías.[26] Para facilitar la carga de la prueba para las víctimas, la AILD introduce una ‘presunción refutable de causalidad’ (presunción refutable de causalidad).[26]

Esta presunción de causalidad se aplica cuando se cumplen tres condiciones clave [12]:

- El demandante demuestra que el demandado (proveedor o usuario) incurrió en una falta (es decir, incumplió un deber de cuidado).

- Es razonablemente probable que la falta haya influido en la salida o el fallo del sistema de IA.

- El demandante demuestra que la salida o el fallo del sistema de IA provocó el daño. La presunción aplica a sistemas de IA de no alto riesgo cuando es excesivamente difícil probar el nexo causal. Sin embargo, en el caso de sistemas de alto riesgo, la presunción no aplica si la evidencia es accesible.[12] Esto significa que el proveedor debe tener evidencia accesible y robusta para defenderse de reclamaciones.

5.2.- Atestación Inmutable como Evidencia Forense

La atestación blockchain convierte el cumplimiento técnico en una ventaja legal. Las soluciones basadas en blockchain demuestran ser útiles para mitigar vulnerabilidades y reducir las denuncias de abuso. [5, 27] La inmutabilidad es el factor clave, ya que asegura que los registros de procesos y los datos utilizados para el entrenamiento sean verificablemente precisos e inalterados.[5]

La atestación proporciona una “coartada algorítmica” legalmente defendible. Si el sistema de atestación (usando VCs de calidad de datos y EAS de modelado) verifica y registra la integridad del modelo y la fuente de datos en el momento se utiliza para probar la diligencia debida. Esto permite al proveedor rebatir la presunción de culpa al demostrar que se cumplieron todas las obligaciones de cuidado (como el requisito de datos “libres de errores” [13]).[12]

Además, si la falta no es refutable, los registros de eventos inmutables permiten un análisis forense preciso para romper el nexo causal. El demandado puede demostrar que el resultado dañino fue causado por una alteración externa o un factor no atribuible al proceso de entrenamiento y despliegue certificado.[12]

5.3.- Cumplimiento de la Obligación de Divulgación de Evidencia

La AI Act y la AILD otorgan a los tribunales la facultad de ordenar la divulgación de evidencia en relación con un sistema de IA de alto riesgo sospechoso de haber causado daño. [12, 26] Si un demandante prueba la plausibilidad de su reclamación, el demandado puede ser obligado a entregar los registros.[12]

La Atestación Blockchain simplifica este proceso:

- Permite la divulgación controlada: En lugar de entregar bases de datos internos vulnerables a cuestionamientos sobre manipulación, el proveedor puede presentar el registro inmutable de eventos de record-keeping anclado en DLT.

- Protección de PI: El uso de ZKPs permite compartir una prueba de cumplimiento o causalidad (que la inferencia fue correcta o incorrecta) sin tener que divulgar los secretos comerciales del modelo, cumpliendo con la orden de divulgación sin exponer la Propiedad Intelectual.[17]La atestación inmutable, por lo tanto, no solo sirve para cumplir con la normativa, sino que funciona como una función defensiva de RegTech, reduciendo significativamente el riesgo de litigio y proveyendo la única evidencia creíble que puede refutar las presunciones de causalidad en un tribunal.

6.- Hoja de Ruta Estratégica y Conclusiones

La integración de la IA en la logística como un pilar estratégico exige una infraestructura de confianza que solo puede ser proporcionada por la atestación inmutable basada en DLT. El cumplimiento de la EU AI Act no es un ejercicio de checkbox , sino una reestructuración de la arquitectura tecnológica en torno a la verificabilidad.

6.1.- Retos de Implementación y Escalamiento

La implementación de la Atestación Blockchain presenta desafíos operativos que deben abordarse estratégicamente. La limitación principal es la escalabilidad de los sistemas de DLT. El consenso distribuido puede generar latencia, lo que podría afectar la velocidad y eficiencia de las transacciones necesarias para registrar flujos de datos de alta frecuencia en tiempo real.[27]

Para mitigar esto, las organizaciones deben enfocarse en soluciones de blockchain de consorcio (consortium blockchain) o redes de capa 2 (Layer 2) que ofrezcan alto rendimiento, y limitar lo que se ancla en la cadena a los hashes y metadatos críticos de procedencia (como se describe en la sección 4.1), en lugar de intentar registrar los datos brutos. Además, es crucial trabajar en consorcios industriales para la cadena de suministro, ya que la atestación requiere la participación verificada de múltiples partes.

6.2.- Recomendaciones Estratégicas para CTOs y CCOs

Para la alta dirección de la logística, la integración de la Atestación Blockchain debe ser una prioridad estratégica para el ciclo 2024-2027:

- Auditoría y Clasificación de Alto Riesgo: Se debe priorizar la identificación y auditoría de todos los sistemas de IA utilizados en operaciones críticas que caigan bajo la definición de “alto riesgo” de la EU AI Act. Dada la extensión de la aplicación para sistemas de alto riesgo hasta agosto de 2027, las empresas tienen un período de gracia para arquitecturizar la solución DLT.[10]

- Inversión en Arquitectura de Atestación (RegTech Defensivo): Invertir en una pila tecnológica que combina SSI/VCs (Hyperledger Aries/Indy) para la identidad y la certificación, y plataformas de ZKML para la verificación de rendimiento. Esta inversión debe transformar los registros internos en evidencia criptográfica verificable, que es el único mecanismo capaz de refutar la presunción de causalidad bajo la AILD.[12]

- Integración en MLOps (Data Provenance by Design): Asegurar que la atestación sea nativa del ciclo de vida de desarrollo de ML (MLOps). Esto incluye la creación automática de VCs para cada cambio de conjunto de datos y cada nueva versión del modelo, garantizando que la trazabilidad y la auditabilidad estén integradas en el diseño del sistema.[13]

6.3.- Conclusión: La Atestación, Fundamento de la Resiliencia Logística 4.0

La tecnología de la Atestación Inmutable, apalancada por Blockchain, SSI y ZKPs, es el fundamento tecnológico para la resiliencia en la Logística 4.0. La convergencia regulatoria (AI Act, AILD, CRA) ha impuesto obligaciones de gobernanza de datos que ya no pueden satisfacerse con herramientas de trazabilidad centralizadas.

Al transformar los registros de eventos internos en activos criptográficos verificables, la atestación proporciona la certeza forense necesaria para gestionar el riesgo de Data Poisoning y Model Collapse , y mitiga la exposición a la Responsabilidad Algorítmica. La confianza en la IA, esencial para alcanzar las ganancias de productividad y la toma de decisiones mejoradas, se convierte así en una característica inherente, transparente y legalmente defendible del ecosistema de la cadena de suministro. La adopción proactiva de esta infraestructura es imperativa para que los líderes logísticos mantengan la agilidad operativa y la ventaja competitiva en el mercado regulado de la próxima década.

Fuentes de Información

- IA agente en logística: un imperativo estratégico | BCG, https://www.bcg.com/publications/ 2025/ai-in-logistics-a-strategic-imperative

- IA en logística: beneficios y aplicaciones potenciales | Oracle América Latina, https:// www.oracle.com/latam/scm/ai-in-logistics/

- Predicciones empresariales de IA para 2025 – PwC, https://www.pwc.com/us/en/tech-effect/ai-analytics/ ai-predictions.html

- Uso de blockchain para impulsar la transparencia y la innovación en la cadena de suministro | Deloitte US, https://www.deloitte.com/us/en/services/consulting/articles/blockchain-supply-chaininnovation.html

- Abordando las Inexactitudes de la IA con Blockchain – BLOCKTAC, https://www.blocktac.com/ novedades/abordando-las-inexactitudes-de-la-ia-con-blockchain/

- ¿Qué es la inteligencia artificial o IA? – IBM, https://www.ibm.com/mx-es/think/topics/artificial-intelligence

- Aplicación de blockchain en la procedencia de datos confiables – Semantic Scholar, https:// www.semanticscholar.org/paper/Application-of-Blockchain-in-Trusted-Data-Mao-Li/ 7750428ca3123cc2ffff2e6ee87eaa1652d69574

- BSTProv: Intercambio de procedencia de datos seguro y confiable basado en blockchain – MDPI, https://www.mdpi.com/2079-9292/11/9/1489

- Integración de blockchain e IA: Perspectivas de expertos para 2025 – GetBlock.io, https:// getblock.io/blog/blockchain-and-ai-integration-expert-perspectives/

- Ley de IA | Configurando el futuro digital de Europa – Unión Europea, https://digital-strategy. ec.europa.eu/en/policies/regulatory-framework-ai

- Claves de la EU AI Act para implementar IA de forma responsable – Revista Big Data, https:// aitalks.es/claves-de-la-eu-ai-act-para-implementar-ia-de-forma-responsable/

- Inteligencia artificial y responsabilidad: conclusiones clave de las recientes evaluaciones de la UE…, https://www.nortonrosefulbright.com/en/knowledge/publications/7052eff6/artificial-intelligenceand-liability

- Resumen de alto nivel de la Ley de IA | Ley de Inteligencia Artificial de la UE, https:// artificialintelligenceact.eu/high-level-summary/

- Artículo 26: Obligaciones de los implementadores de sistemas de IA de alto riesgo | Ley de Inteligencia Artificial de la UE, https://artificialintelligenceact.eu/article/26/

- El poder de la procedencia de los datos para construir ecosistemas digitales confiables y compatibles, https://www.fiware.org/2024/11/21/the-power-of-data-provenance-in-building-trustworthyand-compliant-digital-ecosystems/

- Estadísticas de ataques a la cadena de suministro 2025: Costos, casos, defensas – DeepStrike, https://deepstrike.io/blog/supply-chain-attack-statistics-2025

- Un marco para la verificabilidad criptográfica de canales de IA de extremo a extremo – arXiv, https://arxiv.org/html/2503.22573v1

- Introducción al envenenamiento de datos: Una perspectiva para 2025 | Lakera – Protegiendo a los equipos de IA que transforman el mundo. https://www.lakera.ai/blog/training-data-poisoning

- Protección de datos en la cadena de suministro de IA – Atlantic Council, https:// www.atlanticcouncil.org/in-depth-research-reports/issue-brief/securing-data-in-the-ai-supply-chain/

- LLM03:2025 Cadena de suministro – Proyecto de seguridad de IA de OWASP Gen, https:// genai.owasp.org/llmrisk/llm032025-supply-chain/

- [2404.01413] ¿Es inevitable el colapso del modelo? Rompiendo la maldición de la recursión mediante la acumulación de datos reales y sintéticos – arXiv, https://arxiv.org/abs/2404.01413

- El riesgo de colapso del modelo de IA no se resolverá en 2025 – Winssolutions, https:// www.winssolutions.org/ai-model-collapse-2025-recursive-training/

- Identidades autosoberanas y procedencia del contenido: VeriTrust—A …, https:// www.mdpi.com/1999-5903/17/10/448

- Guía completa sobre los requisitos de datos de entrenamiento de IA – Sparkco, https:// sparkco.ai/blog/comprehensive-guide-to-ai-training-data-requirements

- Estándares de IA | NIST – Instituto Nacional de Estándares y Tecnología, https://www.nist.gov/ artificial-intelligence/ai-standards

- Directiva sobre responsabilidad por inteligencia artificial – Parlamento Europeo, https:// www.europarl.europa.eu/RegData/etudes/BRIE/2023/739342/EPRS_BRI(2023)739342_EN.pdf

- Convergencia tecnológica en el metaverso: retos y soluciones desde blockchain, IA y derechos digitales – Dialnet, https://dialnet.unirioja.es/descarga/articulo/10135220.pdf

¿Te interesa implementar o conocer más sobre nuestra plataforma de attestations? Escríbenos y te mostraremos cómo puede aportar valor real a tu proyecto.

En BlockFarm llevamos la confianza al siguiente nivel: presentamos nuestras attestations en blockchain, comenzando con certificados para animales. Garantiza la autenticidad y trazabilidad de cada ejemplar con la transparencia y seguridad que solo la tecnología blockchain puede ofrecer.